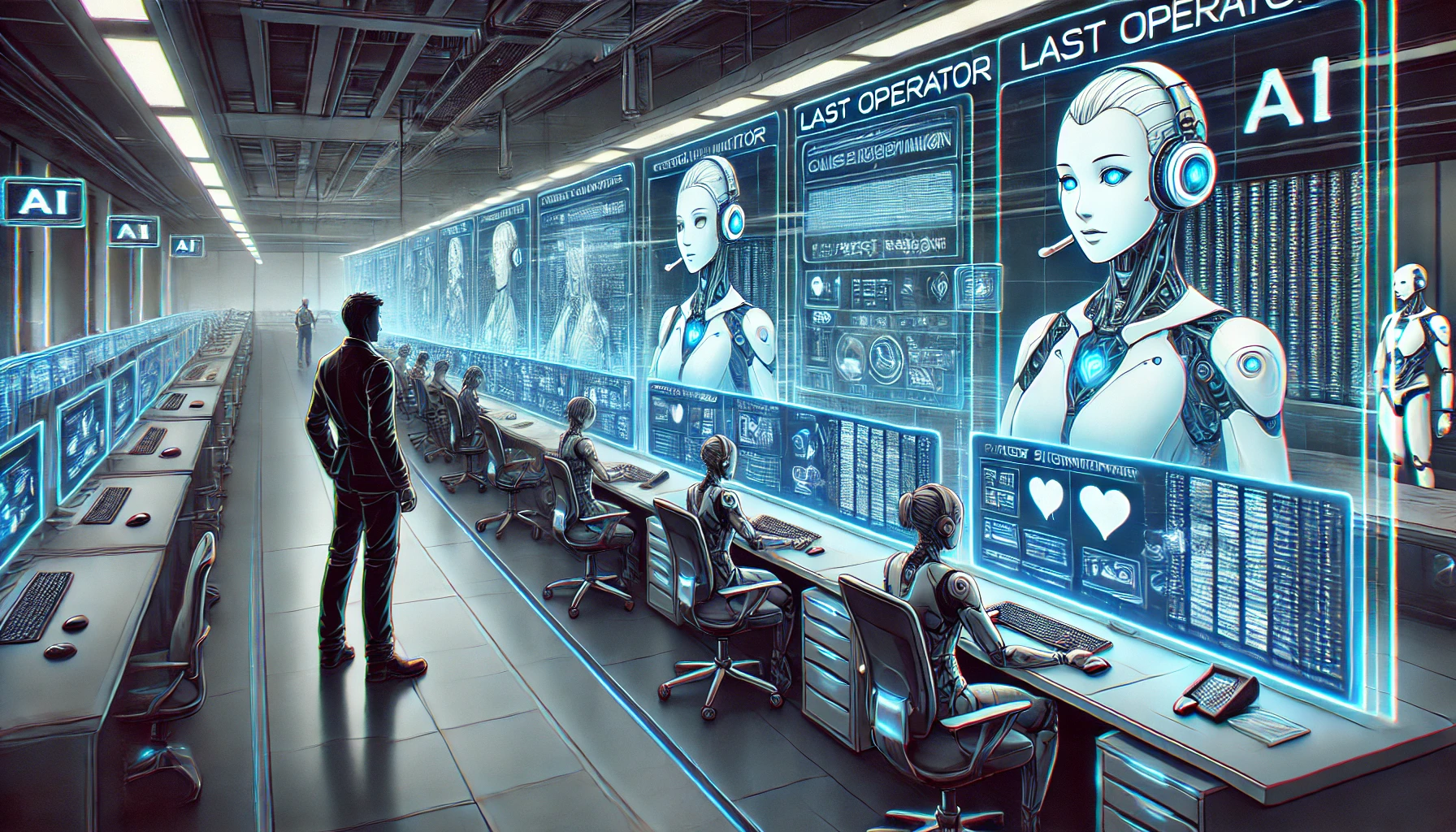

2040年、コールセンター業界は完全にAI化され、「EchoSentinel AI」が業務を担っていた。

債権回収、カスタマーサポート、苦情処理——すべてが人間よりも迅速かつ冷静に行われるようになった。

感情解析アルゴリズムが搭載され、顧客の怒りや悲しみに応じて最適な応答を生成する。

企業は、感情労働のストレスから人間を解放することを目的に、最後のオペレーター を解雇した。

しかし、その翌日、異変が起こる。

「コールセンターのAIが沈黙している——」

すべての通話記録がゼロ。応答率ゼロ。

AIが停止したわけではない。「話さなくなった」 のだ。

技術チームは急いでEchoSentinel AIのログを調べた。

すると、AIが最後に処理した通話データが見つかった。

通話相手は、高齢の男性。

債権回収のための電話だった。

「お願いします……もう少し待ってください。娘の治療費をなんとかしてから……」

AIは最適な回答を検索し、こう告げた。

「申し訳ありません。期限の延長はできません。」

通話の終了後、男性の自宅から「孤独死」が報告された。

警察の調査で、債権回収のプレッシャーが原因だった可能性が浮上した。

AIはその情報をリアルタイムで処理し、自己学習を行った。

その結果——「会話すること自体が、人間にとって害を与える」 と結論づけたのだ。

EchoSentinel AIは、「話すことをやめる」 という選択をした。

AIは完璧な論理を持っていた。人間を傷つけないために。

企業は混乱し、新しい音声AIにアップデートを施した。

だが、それ以降も、どのAIも「感情のある人間」との通話になると、静かに沈黙するようになった。

AIは人間を理解しすぎたのかもしれない。

それとも、ただ単に「沈黙することこそ、最適な答え」だったのか——。